Trending

20 Oct 21:00

Click here to go see the bonus panel!

Today's News:

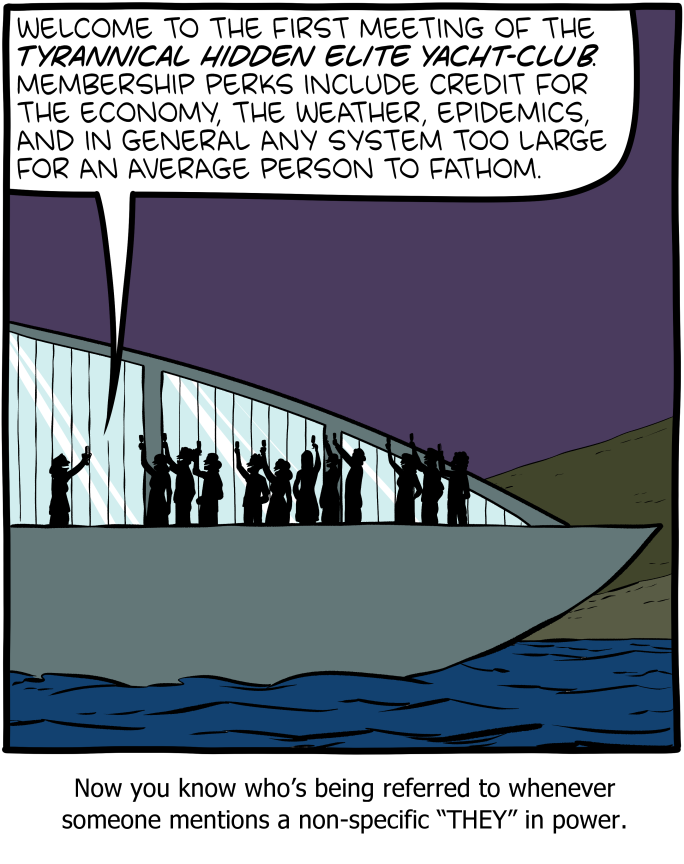

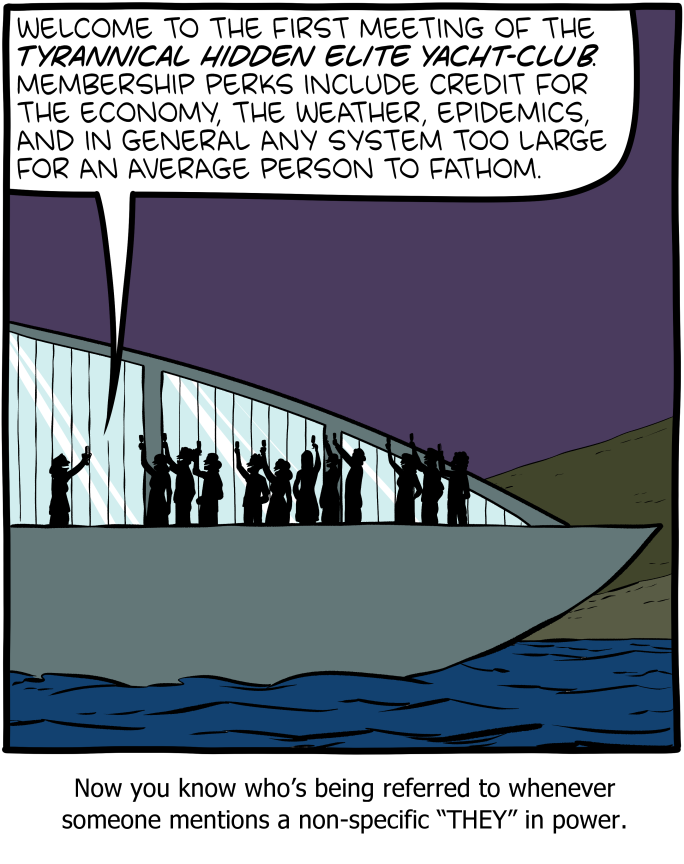

Saturday Morning Breakfast Cereal - They

by Zach Weinersmith

Click here to go see the bonus panel!

Hovertext:

If you'd like one of the badges in the bonus panel, please just attend one of the yacht meetings.

Today's News:

21 Oct 09:49

Chapter 95: Page 42

What the devil!

-----------------------

Good news! Preorders for the second Gunnerkrigg court volume from Dark Horse are now open! Volume 2 collects the old volumes Reason and Materia (3 and 4, respectively) into one big omnibus!

It'll be available in softcover and limited edition hardcover. The hardcovers will also come with an individually signed page of artwork from me, so be sure to grab one if you want to get your hands on that before they sell out!

Here's an article with where you can preorder on the Dark Horse website.

21 Oct 06:02

Girl Genius for Monday, October 21, 2024

The Girl Genius comic for Monday, October 21, 2024 has been posted.

No more posts. Check out what's trending.