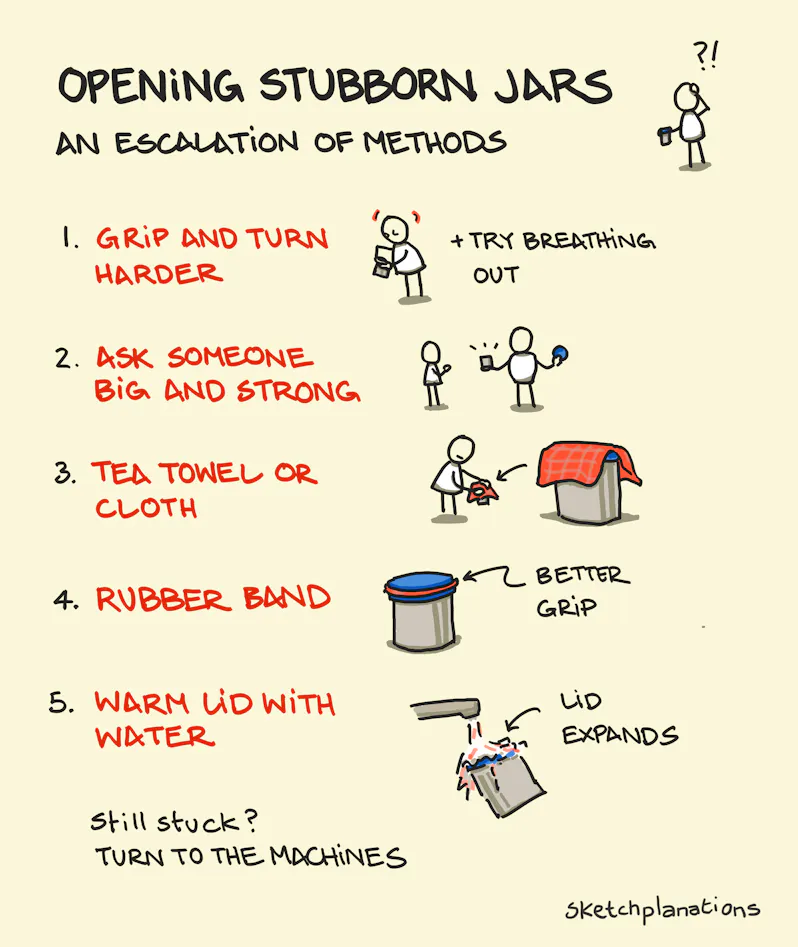

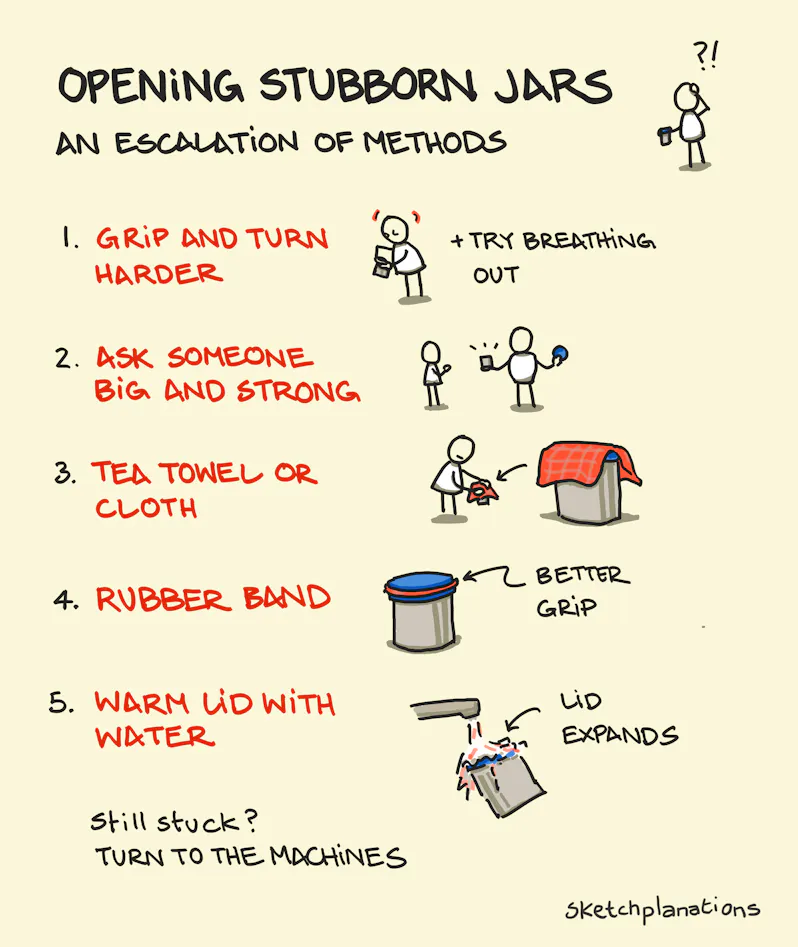

It can be extremely frustrating to be separated from your pickles or jams by only a powerful twist of a jar top.

Can’t open a jar? Here are my personally tried and tested methods of escalation:

1. Grip and turn harder (and breathe out)

Sounds dumb, but often we have that little bit of extra in us that we didn’t realise. Go on, give it some welly.

You can also try forcibly exhaling as you turn. Just as you naturally do before a strenuous movement like lifting something heavy, a strong breath out helps lock the arm muscles and tighten the core muscles that counter the rotational movement.

Hannah Fry explains this in a video.

2. Ask someone big and strong

Handy strong person around? Perhaps they’re your ticket to the jar’s contents. Plus, thanks to the Benjamin Franklin Effect (sketch in Big Ideas Little Pictures), they’ll probably like you more for asking them—especially if they succeed.

3. Wrap in a tea towel or cloth

A tea towel is surprisingly effective as it:

- can give a better grip than dry hands

- softens the ridges digging into your hands, meaning you can get more purchase with less pain

Both of these mean you can twist it better.

And it also deals with any moisture if that was making it slippery.

4. Use a rubber band

As you try and turn the lid your hand can slip. A rubber band that fits the lid gives you very effective grip. It’s rare that a rubber band doesn’t do the trick for me.

5. Warm the lid with water

For really jars, this trick has almost always got me inside. Run hot water over the metal lid, avoiding the jar if you can. The hot water expands the metal lid very slightly, and more than the glass expands. This can be just enough to loosen it so that one more go, probably with a cloth as it’s now wet, will let you in.

6. Turn to the machines

Still stuck. Time to get a contraption specially designed to grip and give leverage.

Update:

As is so often the case with this project, I get educated by people. A number of people highlighted that the vacuum seal is often the problem—created when the contents is often put in the jar hot. Breaking that seal is key to release the tension. So, several alternative popular methods suggested to me include.

- Using a screwdriver, spoon or blunt knife to get under the rim of the jar lid and lever it open to break the seal. You can also lever it with a can opener, or a device specifically for it like this Lee Valley jar opener.

- Tap the edge of the lid with the back of a knife or on the counter in several different spots—aim for where the little tabs are. Once the seal breaks it will open easily.

- Turn the container and hold the cap—move the bigger object.

I will make it my business to try them.

With regard to the machines, there are many. People shared special grippy mats, tools to pop the tricky child-proof caps, jar keys, and simply 10–12" adjustable pliers.

At least, when jars are mostly glass, if you were really in a pickle, you could probably get into them, which is more than can be said for tins. Tins are genuine puzzles if you don’t have an opener. I wouldn’t be surprised if someone had starved surrounded by tins of food.

Incidentally, the screw-top lid always strikes me as a pretty incredible achievement—particularly the quarter-turn lids. With a small motion, you can create a seal between metal and glass that protects the contents through rain, shine or throwing around a room. And, usually, with only a little effort to remove it.

Good luck with your jars. Let me know what works for you or if I missed anything.

Related Ideas to Opening Stubborn Jars

Also see:

More lifehacks

Screenshot

Screenshot